1. 离散卡尔曼滤波

待估计的过程

卡尔曼滤波解决的是离散控制过程状态估计问题,状态$x \in \Re^{n}$, 系统由线性随机差分方程控制:

衡量分布距离在机器学习算法中非常常用,然而分布估计往往运算量大,又不够准确。将分布映射到RKHS上,可以带来很好的性质,因此本篇介绍一下分布嵌入算子,包括边缘嵌入算子,条件嵌入算子和联合嵌入算子。

如果我们定义了一个观测变量和隐变量的联合分布,那么观测变量的分布就可以通过对隐变量边缘化得到,也就是把隐变量积分掉。因此,可以把难以求解的观测变量的边缘分布扩展至一种相对容易处理的方式,即扩展到由观测变量和隐变量构成的联合分布,潜变量的引入可以把复杂的分布拆解成简单的分布。

矩阵点乘,即对应元素相乘

1 | numpy : A * B |

矩阵运算相乘,即 $A\in{R^{n\times m}},$ $B\in{R^{m\times n}}$, $AB\in R^{n\times n}$

1 | numpy : np.dot(A, B) |

查到数组中大于3的元素及索引

1 | numpy : out = [i for i, x in enumerate(e) if x > 3] |

GP回归对多源回归迁移作用很大,因此现在好好学一下。高斯过程回归的加权理解整体做法是,根据少量观测值,预测某组参数的似然概率,然后对所有可能的模型按照概率进行加权,所以这一节定义为’weight-space view’,就是高斯过程回归的加权空间解释。其认为出输出是各种输入的可能性叠加。模型输入包括噪声的方差$\sigma_{n}^{}$,以及参数的协方差矩阵$\Sigma$,输出是带有方差和均值的结果。这个方法整体还是线性的,表现力肯定有限。

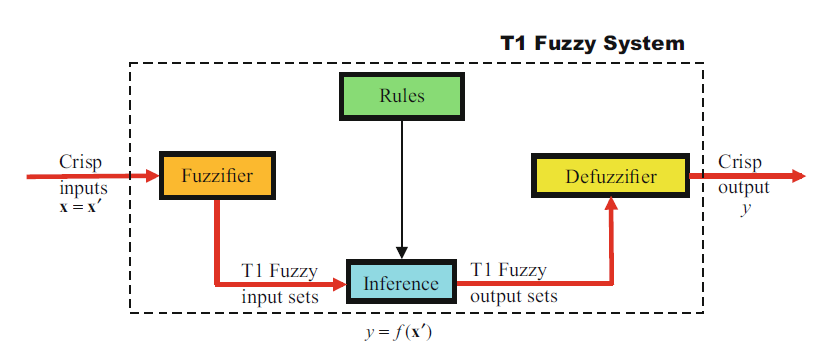

首先开始学习Type-1 fuzzy system (T1 FS), 详细的书中都有,因此这里只从个人理解的方式讲,并非系统学习。T1 FS包括模糊器(Fuzzifier)、推理机(Inference)、规则(Rules)和解模糊器(Defuzzifier)。